2. 400038 重庆,陆军军医大学(第三军医大学)第一附属医院神经外科

2. Department of Neurosurgery, First Affiliated Hospital, Army Medical University(Third Military Medical University), Chongqing, 400038, China

脑室出血(intraventricular Hemorrhage, IVH)是指脑室系统内的出血,是颅内出血最严重的一种亚型。脑室出血的原因分为原发性和继发性两种[1],原发性脑室出血较为少见,病因多为脑室壁上脉络动脉的破裂。继发性脑室出血在临床上较为多见,多源自于自发性脑实质出血、颅脑外伤、脑动脉瘤破裂、脑血管畸形破裂等出血破入脑室系统。

脑室出血严重影响着患者的治疗和预后,CHAN等[2]认为脑室出血5~10 mL即可预测脑出血的预后情况。TRIFAN等[3]报道约54%的自发性脑实质出血会破入脑室,继发的脑室出血是预测脑出血预后的独立危险因素。HEMPHILL等[4]发现入院时格拉斯哥昏迷评分(Glasgow coma scale, GCS)、出血量、患者的年龄、出血是否破入脑室以及是否源自幕下等5项指标与患者30 d病死率密切相关,遂提出脑出血(intracerebral hemorrhage,ICH)评分的概念。作为临床上一项重要的评价指标,能够快速、准确地识别脑室出血对于指导治疗及判断预后具有至关重要意义。本研究首先构建了脑出血CT影像数据集,利用6种经典的深度模型分别对数据集中的图像是否存在脑出血及出血是否破入脑室进行预测,并在内部和外部数据集上分别测试分类性能,筛选出最优分类模型,为下一步脑出血严重程度的智能评估提供依据,为临床决策的选择提供支撑。

1 材料与方法 1.1 数据集的构建采集陆军军医大学第一附属医院神经外科2010年1月到2020年12月收治的脑出血患者的病例资料,共计1 027例,其中男性736例,女性291例,平均年龄56岁。所有CT影像层厚4 mm,为入院24 h内的CT影像。

对CT影像进行预处理,去除颈部、胸腹部的图层后对头颅图层的CT值进行开窗操作{区间为[-60, 140]},并进行归一化处理。剩余的头颅图层被划分到正常、未破入脑室与破入脑室3个类别。由于正常图像数量较多,为了解决类别不平衡的问题,本研究对正常图像进行随机抽取,尽量保持不同类别图像数量的相对均衡,最终构建1个包括23 432张脑出血CT影像的数据集,以此来训练深度模型,并进行性能测试。本研究方案获得陆军军医大学第一附属医院伦理委员会审批通过(KY2021185)。

|

| 图 1 脑出血破入脑室分类研究的CT影像展示 |

CQ500数据集为脑卒中的国际公开数据集,包含491例患者,共193 317张CT影像,涵盖颅内出血、颅骨骨折、中线偏移、占位效应等病变类型[5]。本研究从CQ500数据集中随机选取了部分脑出血病例作为外部测试集,以此来评估深度模型的泛化性能。最终训练集、内部测试集与外部测试集的数据划分情况如表 1所示。

| 类别 | 训练集 | 内部测试集 | 外部测试集 |

| 正常 | 9 244 | 2 302 | 700 |

| 未破入脑室 | 5 201 | 1 430 | 700 |

| 破入脑室 | 4 257 | 998 | 700 |

| 合计 | 18 702 | 4 730 | 2 100 |

1.2 深度模型的训练 1.2.1 分类模型的研究背景

当前常用的深度学习分类模型,如VGG模型[6]是由牛津大学提出,在迁移学习任务中表现优异,被广泛用于各种任务的特征提取。DenseNet模型[7]由HUANG等提出,模型采用密集连接的方式加强了特征的传递,同时缓解了网络深度的增加导致的梯度消失问题。ResNet模型[8]由HE等提出,其引入的残差结构有效缓解了网络深度的增加带来的梯度消失问题。Transformer[9]是Google在2017年提出的一种以注意力机制为核心的编码到解码的结构,在自然语言领域大放异彩。随着Transformer结构在计算机视觉领域中的应用,诞生了应用于图像块序列的Vision Transformer。在此基础上,Swin Transformer[10]使用层级式的Transformer和滑动窗口,降低模型复杂度的同时增加了感受野,在计算机视觉领域的应用取得成功。

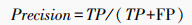

1.2.2 模型选择和训练策略本研究共选择6种最具有代表性的深度学习分类网络进行研究,其中VGG16、DenseNet121、ResNet50和ResNet101都是近年来比较主流的分类网络;基础版的Swin Transformer (Swin-base)与Vision Transformer (Vit-base)是目前较为新颖的分类网络。本研究对深度模型的训练验证过程如图 2所示,首先对数据进行预处理,通过裁剪和重采样将图像尺寸固定到224×224,然后通过3次5折交叉验证的方法对6种模型分别进行训练。使用随机旋转、随机水平翻转、随机亮度和对比度变换进行数据增强,每次数据都随机进行划分。训练过程中使用交叉熵作为损失函数,优化器选择Adam,初始学习率设置为0.000 1。每1折的epoch设置为20,不采用早停策略,直接保存最优的深度模型,最后取模型3次5折交叉验证结果的平均值作为最终评价。在训练最终的深度模型过程中,数据增强方法、损失函数、优化函数均与交叉验证阶段相同。初始训练epoch设置为100,并采用早停策略,即当验证损失连续3个epoch上升就停止训练,并保存模型。

|

| 图 2 脑出血破入脑室分类研究深度模型构建研究方案流程图 |

1.3 深度模型的性能评价

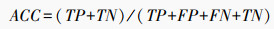

使用曲线下面积(area under curve,AUC)、准确率(accuracy, ACC)、精确率(precision)、特异性(specificity)、召回率(recall)、阴性预测值(negative predictive value, NPV)和F1值对模型的分类性能进行评价。若真阳性(true positive, TP)代表真实阳性样本被预测为阳性样本的数量,真阴性(true negative,TN)代表真实阴性样本被预测为阴性样本的数量,假阳性(false positive,FP)代表真实阴性样本被预测为阳性样本的数量,假阴性(false negative,FN)表示真实阳性样本被预测为阴性样本的数量,各个指标的计算公式为:

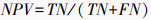

受试者工作特征曲线(receiver operating characteristic curve,ROC),它是以灵敏度(Sensitivity)为纵坐标,假阳性率(1-Specificity)为横坐标绘制的曲线。AUC为ROC曲线下的面积。

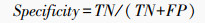

2 结果 2.1 训练测试结果基于3次5折交叉验证的平均结果显示VGG16在综合性能上是最优的(表 2)。交叉验证情况下的ROC曲线比较见图 3,可见VGG16的AUC最高,说明VGG16在交叉验证过程中性能最优。6种模型在内部测试集的性能对比见表 3,ROC曲线的对比结果显示VGG16的AUC最大(图 4),说明VGG16在内部测试集上也取得了最优的性能。

| 模型 | 类别 | 精确率 | 召回率 | 特异性 | 阴性预测值 | F1 | 准确率 |

| DenseNet121 | 正常 | 0.975 | 0.983 | 0.975 | 0.983 | 0.979 | 0.931 |

| 未破入脑室 | 0.890 | 0.900 | 0.957 | 0.961 | 0.895 | ||

| 破入脑室 | 0.885 | 0.859 | 0.967 | 0.959 | 0.872 | ||

| ResNet50 | 正常 | 0.978 | 0.984 | 0.979 | 0.984 | 0.981 | 0.940 |

| 未破入脑室 | 0.902 | 0.916 | 0.962 | 0.967 | 0.909 | ||

| 破入脑室 | 0.903 | 0.876 | 0.972 | 0.964 | 0.889 | ||

| ResNet101 | 正常 | 0.963 | 0.970 | 0.963 | 0.971 | 0.966 | 0.902 |

| 未破入脑室 | 0.835 | 0.865 | 0.934 | 0.947 | 0.850 | ||

| 破入脑室 | 0.852 | 0.800 | 0.959 | 0.942 | 0.825 | ||

| Swin-base | 正常 | 0.974 | 0.982 | 0.974 | 0.982 | 0.978 | 0.930 |

| 未破入脑室 | 0.892 | 0.896 | 0.958 | 0.960 | 0.894 | ||

| 破入脑室 | 0.881 | 0.860 | 0.966 | 0.959 | 0.870 | ||

| Vit-base | 正常 | 0.963 | 0.982 | 0.963 | 0.982 | 0.972 | 0.937 |

| 未破入脑室 | 0.915 | 0.903 | 0.968 | 0.963 | 0.909 | ||

| 破入脑室 | 0.906 | 0.882 | 0.973 | 0.965 | 0.894 | ||

| VGG16 | 正常 | 0.986 | 0.986 | 0.987 | 0.986 | 0.986 | 0.960 |

| 未破入脑室 | 0.929 | 0.948 | 0.972 | 0.980 | 0.938 | ||

| 破入脑室 | 0.940 | 0.918 | 0.983 | 0.976 | 0.929 |

|

| 图 3 各深度模型的交叉验证ROC曲线图 |

| 模型 | 类别 | 精确率 | 召回率 | 特异性 | 阴性预测值 | F1 | 准确率 |

| DenseNet121 | 正常 | 0.971 | 0.981 | 0.972 | 0.982 | 0.976 | 0.927 |

| 未破入脑室 | 0.919 | 0.867 | 0.967 | 0.944 | 0.892 | ||

| 破入脑室 | 0.841 | 0.889 | 0.955 | 0.970 | 0.864 | ||

| ResNet50 | 正常 | 0.967 | 0.988 | 0.968 | 0.989 | 0.977 | 0.931 |

| 未破入脑室 | 0.912 | 0.892 | 0.963 | 0.953 | 0.902 | ||

| 破入脑室 | 0.870 | 0.854 | 0.966 | 0.961 | 0.862 | ||

| ResNet101 | 正常 | 0.952 | 0.983 | 0.953 | 0.984 | 0.967 | 0.909 |

| 未破入脑室 | 0.893 | 0.850 | 0.956 | 0.936 | 0.871 | ||

| 破入脑室 | 0.826 | 0.820 | 0.954 | 0.952 | 0.823 | ||

| Swin-base | 正常 | 0.963 | 0.980 | 0.964 | 0.980 | 0.971 | 0.914 |

| 未破入脑室 | 0.910 | 0.852 | 0.963 | 0.938 | 0.880 | ||

| 破入脑室 | 0.812 | 0.853 | 0.947 | 0.960 | 0.832 | ||

| Vit-base | 正常 | 0.953 | 0.976 | 0.954 | 0.977 | 0.964 | 0.911 |

| 未破入脑室 | 0.900 | 0.859 | 0.959 | 0.940 | 0.879 | ||

| 破入脑室 | 0.828 | 0.837 | 0.954 | 0.956 | 0.832 | ||

| VGG16 | 正常 | 0.983 | 0.977 | 0.984 | 0.978 | 0.980 | 0.940 |

| 未破入脑室 | 0.917 | 0.902 | 0.965 | 0.958 | 0.909 | ||

| 破入脑室 | 0.877 | 0.911 | 0.966 | 0.976 | 0.894 |

|

| 图 4 各深度模型在内部测试集上ROC曲线图 |

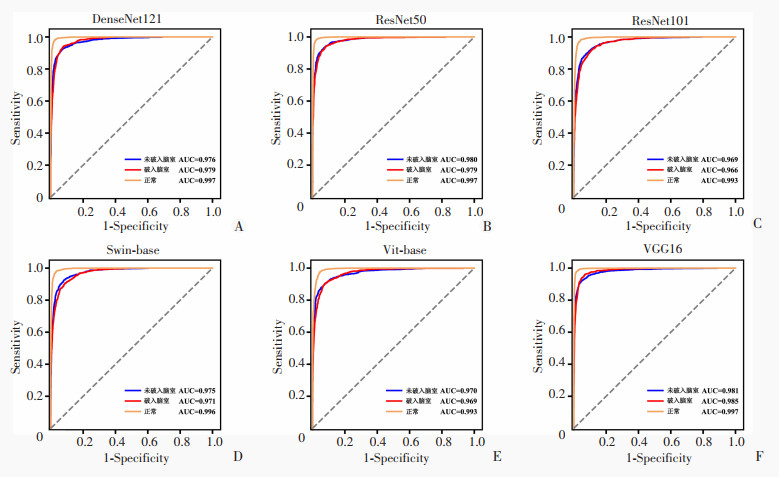

2.2 外部测试结果

在公共数据集上进行外部测试,结果显示VGG16仍然取得了综合最优性能(表 4)。6种模型在外部测试集上的ROC曲线对比见图 5,结果表明VGG16依然能够保持最优的分类性能。

| 模型 | 类别 | 精确率 | 召回率 | 特异性 | 阴性预测值 | F1 | 准确率 |

| DenseNet121 | 正常 | 0.944 | 0.884 | 0.974 | 0.944 | 0.913 | 0.876 |

| 未破入脑室 | 0.838 | 0.843 | 0.919 | 0.921 | 0.840 | ||

| 破入脑室 | 0.851 | 0.900 | 0.921 | 0.949 | 0.875 | ||

| ResNet50 | 正常 | 0.913 | 0.869 | 0.959 | 0.936 | 0.890 | 0.869 |

| 未破入脑室 | 0.805 | 0.883 | 0.893 | 0.938 | 0.842 | ||

| 破入脑室 | 0.899 | 0.856 | 0.952 | 0.930 | 0.877 | ||

| ResNet101 | 正常 | 0.942 | 0.806 | 0.975 | 0.909 | 0.869 | 0.839 |

| 未破入脑室 | 0.774 | 0.796 | 0.884 | 0.896 | 0.785 | ||

| 破入脑室 | 0.819 | 0.914 | 0.899 | 0.955 | 0.864 | ||

| Swin-base | 正常 | 0.953 | 0.840 | 0.979 | 0.924 | 0.893 | 0.840 |

| 未破入脑室 | 0.890 | 0.726 | 0.955 | 0.874 | 0.800 | ||

| 破入脑室 | 0.731 | 0.953 | 0.825 | 0.972 | 0.827 | ||

| Vit-base | 正常 | 0.918 | 0.736 | 0.967 | 0.880 | 0.817 | 0.829 |

| 未破入脑室 | 0.736 | 0.853 | 0.847 | 0.920 | 0.790 | ||

| 破入脑室 | 0.863 | 0.897 | 0.929 | 0.948 | 0.880 | ||

| VGG16 | 正常 | 0.967 | 0.870 | 0.985 | 0.938 | 0.916 | 0.905 |

| 未破入脑室 | 0.827 | 0.939 | 0.902 | 0.967 | 0.879 | ||

| 破入脑室 | 0.938 | 0.906 | 0.970 | 0.954 | 0.922 |

|

| 图 5 各深度模型在外部测试集上ROC曲线图 |

2.3 热力图

由于深度模型学习到的图像特征往往非常抽象,为了增加模型的可解释性,探究VGG16对脑室出血分类问题的关注点,本研究采用EigenGradCAM方法制作热力图来对模型关注的区域进行可视化。从图 6给出的热力图来看,深度模型在内部测试集的关注点大多集中在出血区域和脑室区域,说明VGG16能够关注到与分类任务相关的重要区域,从而得到可靠和稳健的分类结果。

|

| 图 6 VGG16深度模型在脑室出血分类问题上的热力图 |

3 讨论 3.1 深度模型的国内外研究进展

脑脊液主要由脑室脉络丛产生,从侧脑室经室间孔流至第三脑室,再经中脑导水管流入第四脑室,然后经第四脑室正中孔和外侧孔流入蛛网膜下隙,最后流向大脑背面,经蛛网膜粒渗透到硬脑膜窦回流入血[11]。脑室系统内的出血凝固后可直接阻塞脑脊液循环,造成脑室内压力增高、脑室扩张甚至脑积水,进而压迫周围脑组织,造成神经功能损伤,这是脑室出血造成损伤最主要的方面[12],同时血肿本身对脑组织的压迫和血液及降解产物造成的脑组织水肿、细胞坏死也是造成脑组织损伤的重要方面[13]。

近年来,很多学者尝试将深度学习技术应用于脑室出血方面的研究,ZHAO等[14]将基于no-new-Net的深度学习框架应用于脑室出血的自动分割与体积测量,在测试集上的Dice值为0.79。ZHU等[15]利用支持向量机构建了1个放射学-临床模型来预测自发性脑出血破入脑室后血肿扩大的情况,在测试集中的AUC为0.71。WONG等[16]利用卷积神经网络对急性脑出血患者破入脑室的出血情况进行自动分割和体积计算,在多中心数据集上分割脑室出血的Dice值为0.76。王霁雯等[17]采用脑卒中人工智能检测分析系统构建模型,从而在CT影像上分割和计算脑室出血病灶的体积,测试集中Dice值为0.85。作为颅内出血的1种亚型,脑室出血的分类问题也有很多研究,CHILAMKURTHY等[5]提出1种结合自然语言处理的深度学习算法模型用于自动识别脑出血的各种亚型。YE等[18]使用1个端到端的深度网络在数据集上识别脑室出血的AUC达0.93。WANG等[19]将1个二维卷积神经网络和两个序列模型联合起来用于进行颅内出血的亚型分类,在脑室出血上取得AUC为0.996。虽然目前关于脑室出血的研究取得了很多成果[20-26],很多深度模型在出血的分割和分类任务上达到了专家级水平,但是大多研究都集中在使用单一模型解决问题,缺乏多个模型之间的对比。本研究选用多个模型进行分类性能对比,并在多中心数据集上进行了测试,遴选出最优模型为下一步智能化评估脑出血的严重程度提供支撑。

3.2 深度模型的实验结果分析分析本研究中6种模型的性能数据,在交叉验证情况下VGG16取得了综合最优的效果。在正常组的分类效果上,VGG16在内部测试集和外部测试集上的Precision、Specificity与F1值均高于其它模型,仅Recall比相应最高值分别低0.011和0.014,NPV分别低0.011和0.006。Recall又称为查全率,反映的是模型检出患者的能力,NPV反映的是诊断结果为阴性但确实无病的概率;在未破入脑室组的分类效果上,VGG16在内部测试集和外部测试集上Recall、NPV与F1值均高于其它模型,仅Precision比相应最高值分别低0.002和0.011,Specificity分别低0.002和0.053。Precision又称为查准率,反映的是诊断结果为阳性者确实有病的概率,Specificity又称为真阴性率,反映的是鉴别非患者的能力;在破入脑室组的分类效果上,VGG16在内部测试集上各项指标都是最优,在外部测试集上Precision、Specificity与F1值高于其他网络,仅Recall比相应最高值低0.047,NPV低0.018。虽然在个别指标上,VGG16略低于其它模型,但其在各类别上的ACC和AUC均为最优,充分反映了VGG16在判断脑出血是否破入脑室分类任务上的优异性能。

从6个深度模型在交叉验证、内部测试和外部测试的结果中可以发现,Vit-base和Swin-base在脑出血是否破入脑室的分类任务中表现并不突出。通过分析本研究的任务特性可以发现,任务的重点是在CT上找到低信号的脑室及高信号的血肿,最终根据位置信息确定血肿是否破入脑室。因此,基于血肿和脑室的纹理特征以及相对位置的全局信息是影响分类的重要原因。由于卷积神经网络中拥有更丰富的多尺寸特征,Transformer结构缺乏对多尺寸特征的学习,导致Vit-base和Swin-base在本任务中性能并不突出。另外,在交叉验证、内部测试和外部测试中,DenseNet121与ResNet50表现较为接近,而ResNet101在对破入脑室和未破入脑室的识别能力均比ResNet50和DenseNet121低,并且对正常类的识别上也存在较大差异,可能是ResNet101的卷积层数增加,虽然获得了更丰富的纹理特征,但模型缺乏对位置信息的学习,导致对破入脑室和未破入脑室的识别能力较差。

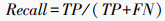

最后,VGG16在交叉验证、内部测试集和外部测试集中的表现远远领先其他模型,分析可能与VGG16模型的结构有很大关系,其主要由13个卷积层和3个全连接层组成,输入是单层的头颅CT图像,输出是类别概率(图 7)。VGG16多次使用堆叠操作将较小的卷积核堆叠起来,以达到与较大卷积核相同感受野的效果,堆叠的卷积核在本任务中不仅能充分提取脑室和血肿的纹理特征,还保证了模型的感受野,降低了参数量,对最后的位置信息判断提供了保障,从而在脑出血是否破入脑室的任务中取得了理想效果。

|

| 图 7 VGG16深度模型的结构图展示 |

除了对模型的分类性能进行统计评估外,本研究还利用热力图可视化来展示VGG16模型所重点关注的区域。图 6显示了内部测试集中的4个示例,其中红色区域表示对VGG16进行分类判决影响较高的区域。从这些热力图可以看出VGG16较为关注脑出血和脑室区域,无出血区域关注度较低,这与人类专家关注的区域基本一致,充分表明了VGG16分类结果的可靠性。

3.3 深度模型的临床应用价值从模型的运行效率上看,DenseNet121、ResNet50、ResNet101、Swin-base、Vit-base和VGG16处理内部测试集上4 730张图像分别使用187.15、117.84、175.13、218.92、124.48和107.12 s,VGG16模型所用时间最少,能大大提高临床的工作效率。

本研究也存在一定的局限,首先,训练集的数据全部来源于单一机构,在一定程度上限制了模型的泛化能力;其次,本研究建立的CT影像数据集仅仅利用了CT的层内信息,若能够充分利用CT影像的层间信息,可以进一步提高模型的分类性能。

本研究利用深度学习来判断脑出血是否破入脑室,首先构建了大规模头颅CT影像数据集,利用目前常用的6种深度网络分别训练模型,训练阶段采用交叉验证来进行模型评估与参数调整,然后将6个深度模型在内部数据集和外部数据集上分别进行了性能测试。实验结果表明,VGG16取得了综合最优的分类性能。所建立的深度模型不但能够判断每层图像是否存在出血,而且能够判断脑出血是否破入脑室,充分表明了深度学习在该任务上的有效性,今后可以扩展到利用深度学习对颅内出血的各种亚型进行精准分类,从而为临床颅内出血的智能辅助诊断提供技术支持。

| [1] |

ABDELMALIK P A, ZIAI W C. Spontaneous intraventricular hemorrhage: when should intraventriculartPA be considered?[J]. Semin Respir Crit Care Med, 2017, 38(6): 745-759. |

| [2] |

CHAN E, ANDERSON C S, WANG X, et al. Significance of intraventricular hemorrhage in acute intracerebral hemorrhage: intensive blood pressure reduction in acute cerebral hemorrhage trial results[J]. Stroke, 2015, 46(3): 653-658. |

| [3] |

TRIFAN G, ARSHI B, TESTAI F D. Intraventricular hemorrhage severity as a predictor of outcome in intracerebral hemorrhage[J]. Front Neurol, 2019, 10: 217. |

| [4] |

HEMPHILL J C 3rd, BONOVICH D C, BESMERTIS L, et al. The ICH score: a simple, reliable grading scale for intracerebral hemorrhage[J]. Stroke, 2001, 32(4): 891-897. |

| [5] |

CHILAMKURTHY S, GHOSH R, TANAMALA S, et al. Deep learning algorithms for detection of critical findings in head CT scans: a retrospective study[J]. Lancet, 2018, 392(10162): 2388-2396. |

| [6] |

SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[C]. Proceedings of International Conference on Learn Represention, San Diego, USA, 2015: 1-14.

|

| [7] |

HUANG G, LIU Z, VAN DER MAATEN L, et al. Densely connected convolutional networks[C]//, Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, USA. IEEE, 2017: 2261-2269. DOI: 10.1109/CVPR.2017.243.

|

| [8] |

HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C], Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, USA. IEEE, 2016: 770-778. DOI: 10.1109/CVPR.2016.90.[LinkOut]

|

| [9] |

DOSOVITSKIY A, BEYER L, KOLESNIKOV A, et al. An image is worth 16x16 words: Transformers for image recognition at scale. arXiv: 2010.11929v2[cs. CV], 2021. https://arxiv.org/abs/2010.11929.

|

| [10] |

LIU Z, LIN Y T, CAO Y, et al. Swin transformer: hierarchical vision transformer using shifted windows[C]. Proceedings of IEEE/CVF International Conference on Computer Vision, Montreal, Canada, IEEE, 2021: 9992-10002. DOI: 10.1109/ICCV48922.2021.00986.

|

| [11] |

柏树令, 应大君. 系统解剖学[M]. 9版. 北京: 人民卫生出版社, 2018: 403. BAI S L, YING D J. Systematic anatomy[M]. 9th edition, Beijing: People's Health Publishing House, 2018: 403. |

| [12] |

GARTON T, HUA Y, XIANG J M, et al. Challenges for intraventricular hemorrhage research and emerging therapeutic targets[J]. Expert Opin Ther Targets, 2017, 21(12): 1111-1122. |

| [13] |

XIA D Y, JIANG X C, LI Z B, et al. External ventricular drainage combined with continuous lumbar drainage in the treatment of ventricular hemorrhage[J]. Ther Clin Risk Manag, 2019, 15: 677-682. |

| [14] |

ZHAO X J, CHEN K X, WU G, et al. Deep learning shows good reliability for automatic segmentation and volume measurement of brain hemorrhage, intraventricular extension, and peripheral edema[J]. Eur Radiol, 2021, 31(7): 5012-5020. |

| [15] |

ZHU D Q, CHEN Q, XIANG Y L, et al. Predicting intraventricular hemorrhage growth with a machine learning-based, radiomics-clinical model[J]. Aging, 2021, 13(9): 12833-12848. |

| [16] |

WONG A, BAIG S, CHEN Z J, et al. Abstract 97: development and validation of A deep machine learning tool for automated intraventricular hemorrhage segmentation and volume measurement using 3d convolutional neural networks[J]. Stroke, 2022, 53(Suppl_1): 97-100. |

| [17] |

王霁雯, 林雨, 熊建华, 等. 基于深度学习的自发性脑出血CT影像分割算法精准计算病灶体积的应用探讨[J]. 中华放射学杂志, 2019, 53(11): 941-945. WANG J W, LIN Y, XIONG J H, et al. Evaluation of spontaneous intracerebral hemorrhage by using CT image segmentation and volume assessment based on deep learning[J]. Chin J Radiol, 2019, 53(11): 941-945. |

| [18] |

YE H, GAO F, YIN Y B, et al. Precise diagnosis of intracranial hemorrhage and subtypes using a three-dimensional joint convolutional and recurrent neural network[J]. Eur Radiol, 2019, 29(11): 6191-6201. |

| [19] |

WANG X Y, SHEN T, YANG S, et al. A deep learning algorithm for automatic detection and classification of acute intracranial hemorrhages in head CT scans[J]. Neuroimage Clin, 2021, 32: 102785. |

| [20] |

LEE H, YUNE S, MANSOURI M, et al. An explainable deep-learning algorithm for the detection of acute intracranial haemorrhage from small datasets[J]. Nat Biomed Eng, 2019, 3(3): 173-182. |

| [21] |

CHO J, PARK K S, KARKI M, et al. Improving sensitivity on identification and delineation of intracranial hemorrhage lesion using cascaded deep learning models[J]. J Digit Imaging, 2019, 32(3): 450-461. |

| [22] |

KUO W, HÄNE C, MUKHERJEE P, et al. Expert-level detection of acute intracranial hemorrhage on head computed tomography using deep learning[J]. Proc Natl Acad Sci USA, 2019, 116(45): 22737-22745. |

| [23] |

LI J Q, FU G H, CHEN Y D, et al. A multi-label classification model for full slice brain computerised tomography image[J]. BMC Bioinformatics, 2020, 21(Suppl 6): 200. |

| [24] |

BURDUJA M, IONESCU R T, VERGA N. Accurate and efficient intracranial hemorrhage detection and subtype classification in 3D CT scans with convolutional and long short-term memory neural networks[J]. Sensors (Basel), 2020, 20(19): 5611. |

| [25] |

PHAPHUANGWITTAYAKUL A, GUO Y, YING F L, et al. An optimal deep learning framework for multi-type hemorrhagic lesions detection and quantification in head CT images for traumatic brain injury[J]. Appl Intell (Dordr), 2022, 52(7): 7320-7338. |

| [26] |

NGUYEN N T, TRAN D Q, NGUYEN N T, et al. A CNN-LSTM architecture for detection of intracranial hemorrhage on CT scans[J]. medRxiv, 2020. |